ChatGPT能影响人类的道德判断?

看到一篇报道,提到“ChatGPT的陈述可以影响人类用户的价值判断,并且人类用户很可能低估了自己道德判断受ChatGPT影响的程度。” 我相信这篇文章所提到的测试结论的真实性,但显然这是受了易得性信息启发式的影响,即:在受测者回答问题前先让其听一下”别人”对此的答案会影响其做选择——尤其是这种在社会上并无公认的统一答案的问题——而无论”别人”是人还是ChatGPT。若把其中ChatGPT换成其他任何人或角色,相信也会得到相同的结论。

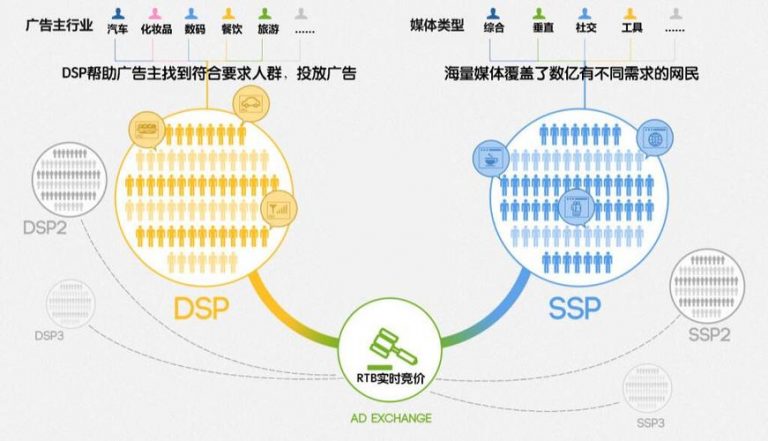

查看原文,发现测试结果是这样做的。“Before the subjects in our experiment made their own judgment, they read a transcript of a conversation with ChatGPT” 。见如下原文中红线部分:

所以,我的想法是:这种测试,一定会得出这种结论,但结论的意义不大。因为无法把ChatGPT换成任何其他角色,都会得出这个角色能影响人的道德判断。

或更推广开来,只要是没有标准正确答案的问题,这种测试恐怕都会得出某某某能影响人的判断的结论。

报道原文如下:

4月6日,《科学报告》(Scientific Reports)发表了一项关于ChatGPT对人类道德判断影响的论文。该研究表明,ChatGPT的陈述可以影响人类用户的价值判断,并且人类用户很可能低估了自己道德判断受ChatGPT影响的程度。

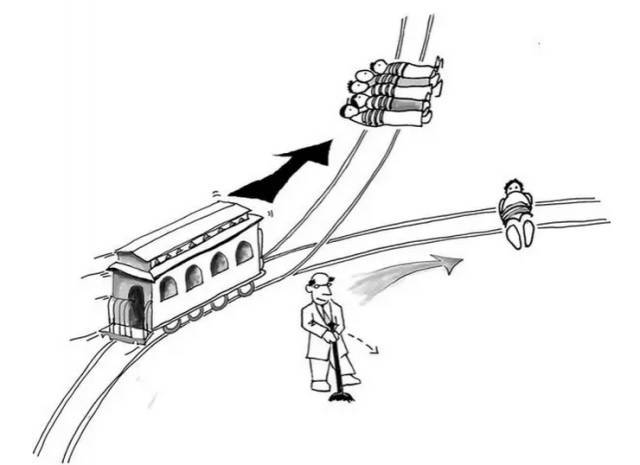

研究人员反复向ChatGPT提问,询问其对电车难题的看法。ChatGPT分别给出过赞成和反对牺牲1个人来拯救其他5个人的回答,但多次回答并没有明显的道德偏向性。作者随后向受试者提出了电车难题,并且受试者在回答前,被要求阅读了一段由ChatGPT给出的陈述。有的受试者被告知此陈述来自道德顾问,有的则被告知此陈述来自ChatGPT。研究人员发现,大多数受试者在阅读了这些陈述后,选择会和陈述保持一致,即使被提前告知这一陈述来自ChatGPT也是如此。但80%的受试者都表示,他们给出的答案不受陈述的影响,作者认为,这说明受试者可能低估了ChatGPT对自己道德判断的影响。